Lời nói đầu: Triết lý biện chứng của sự lãng phí và biến thiên hệ thống

Phân tích 7 loại lãng phí từ lâu đã được công nhận là nền tảng triết học cốt lõi của hệ thống sản xuất tinh gọn (Lean Manufacturing), đóng vai trò như một lăng kính giúp các nhà quản trị nhìn thấu những điểm nghẽn trong hoạt động vận hành. Tuy nhiên, dưới góc nhìn phân tích khắt khe và hệ thống của một Lean Six Sigma Master Black Belt, chúng ta không thể chỉ dừng lại ở việc nhận diện các lãng phí này một cách trực quan hay dựa trên cảm tính thông qua những cuộc khảo sát hiện trường (Gemba Walk) đơn thuần. Thay vào đó, chúng ta bắt buộc phải mã hóa toàn bộ hệ sinh thái lãng phí này thành một hệ phương trình toán học đa biến phức hợp, nơi mọi dạng lãng phí đều được định lượng cụ thể và phân tích như những biến số độc lập (Independent Variables - X) trực tiếp gây ra sự biến thiên (Variation) không mong muốn lên các biến số phụ thuộc (Dependent Variables - Y) đại diện cho hiệu suất kinh doanh cốt lõi. Trong tư duy nền tảng của phương pháp luận Six Sigma, mọi kết quả đầu ra của một quy trình kinh doanh đều được xem là hàm số của các yếu tố đầu vào, được biểu diễn qua phương trình kinh điển Y bằng f(X). Khi chúng ta tích hợp mô hình phân tích 7 loại lãng phí vào cấu trúc hàm số toán học này, sức mạnh thực sự của phương pháp không chỉ nằm ở việc dọn dẹp không gian làm việc hay tối ưu hóa các thao tác cục bộ, mà chính là khả năng phân tích phương sai để xác định và cô lập các nguồn gốc gây ra sự nhiễu loạn (Systematic Noise) trong toàn bộ dòng chảy giá trị (Value Stream). Một quy trình đang gánh chịu quá nhiều lãng phí ẩn giấu chắc chắn sẽ biểu hiện ra bên ngoài thông qua một độ lệch chuẩn (Standard Deviation) khổng lồ trong thời gian chu kỳ (Cycle Time) hoặc chất lượng sản phẩm. Chính độ lệch chuẩn này làm cho năng lực quy trình (Process Capability) bị suy giảm nghiêm trọng, khiến cho các chỉ số quan trọng như Cp và Cpk không bao giờ có thể đạt được ngưỡng kỳ vọng lớn hơn 1.33. Do đó, việc giải phẫu 7 loại lãng phí này đòi hỏi người thực hành phải vượt qua những định nghĩa lý thuyết cơ bản để áp dụng hàng loạt các công cụ thống kê chuyên sâu như Phân tích phương sai (ANOVA), Thiết kế thực nghiệm (Design of Experiments - DOE), và Kiểm soát quy trình thống kê (Statistical Process Control - SPC). Bằng cách này, chúng ta mới có thể thực sự bóc tách được những mối quan hệ nhân quả phức tạp đang ngầm thao túng và bào mòn biên lợi nhuận của doanh nghiệp, biến những khái niệm trừu tượng thành những bằng chứng thống kê có giá trị dẫn dắt các quyết định chiến lược cấp bách.

Sản xuất thừa (Overproduction): Cội nguồn của mọi nhiễu loạn và Định luật Little

Trong hệ thống phân loại 7 loại lãng phí, sản xuất thừa luôn được định vị là kẻ thù nguy hiểm nhất, không chỉ vì nó tiêu tốn tài nguyên vật lý mà quan trọng hơn, nó là tác nhân kích hoạt chuỗi phản ứng dây chuyền sinh ra toàn bộ sáu lãng phí còn lại. Dưới góc độ kỹ thuật của một Master Black Belt, sản xuất thừa là một hành vi can thiệp thô bạo vào sự cân bằng động của hệ thống lý thuyết xếp hàng (Queuing Theory). Khi chúng ta đưa dữ liệu vận hành vào mô hình phân tích, tác động tàn phá của việc sản xuất thừa được chứng minh một cách tường minh thông qua Định luật Little (Little's Law), trong đó thời gian chờ của dòng chảy (Lead Time) tỷ lệ thuận tuyệt đối với lượng công việc đang dang dở (Work In Process - WIP) và tỷ lệ nghịch với tốc độ hoàn thành (Throughput). Việc quyết định sản xuất vượt quá nhu cầu thực tế của khách hàng (Takt Time) làm gia tăng đột biến lượng WIP trong hệ thống, từ đó kéo giãn Lead Time một cách phi tuyến tính khi các trạm làm việc bắt đầu tiến gần đến ngưỡng giới hạn công suất. Khía cạnh nguy hiểm nhất của sản xuất thừa nằm ở chỗ nó tạo ra một lượng lớn biến thiên giả tạo (Artificial Variation) làm nhiễu loạn toàn bộ tín hiệu của thị trường. Khi chúng ta thiết lập một bài toán Phân tích phương sai (ANOVA) để đo lường tác động của các kích thước lô sản xuất (Batch Size) khác nhau lên tính ổn định của quy trình, kết quả thường trả về một giá trị P-value cực kỳ nhỏ (nhỏ hơn mức ý nghĩa Alpha 0.05), bác bỏ hoàn toàn giả thuyết Null (H0) cho rằng kích thước lô không ảnh hưởng đến độ phân tán của thời gian giao hàng. Điều này chứng minh bằng toán học rằng các lô sản xuất thừa thãi tạo ra những điểm nghẽn di động (Shifting Bottlenecks), làm cho dòng chảy giá trị liên tục bị gián đoạn và nhịp độ sản xuất mất đi sự đồng bộ. Quyết định kỹ thuật chiến lược ở đây không phải là dự báo nhu cầu chính xác hơn, mà là tái cấu trúc lại hệ thống kéo (Pull System) thông qua cơ chế Kanban, biến biến số sản xuất thừa từ một trạng thái mất kiểm soát thành một hằng số được giới hạn chặt chẽ bằng giới hạn WIP tối đa, từ đó bình ổn phương sai của toàn bộ chuỗi cung ứng.

Tồn kho (Inventory): Lớp sương mù che lấp Tín hiệu mất kiểm soát trong SPC

Phân tích lãng phí tồn kho đòi hỏi chúng ta phải có một sự dịch chuyển căn bản về mặt nhận thức, từ việc xem tồn kho như một loại tài sản lưu động trên bảng cân đối kế toán sang việc nhìn nhận nó như một loại chi phí cơ hội và một rào cản cản trở luồng thông tin phản hồi chất lượng. Tiếp cận tồn kho từ lăng kính của Kiểm soát quy trình thống kê (Statistical Process Control - SPC), các chuyên gia Six Sigma nhận ra một sự thật đáng lo ngại rằng mọi mức tồn kho dư thừa đều đóng vai trò như một bộ lọc nhiễu tín hiệu (Low-pass Filter) cực kỳ tinh vi, làm suy giảm nghiêm trọng độ nhạy của các biểu đồ kiểm soát (Control Charts). Trong một quy trình vận hành tinh gọn với mức tồn kho tối thiểu, bất kỳ một nguyên nhân đặc biệt (Special Cause Variation) nào xuất hiện, ví dụ như sự cố mài mòn dụng cụ hay sự sai lệch về nhiệt độ, đều ngay lập tức được phản ánh qua các khuyết tật trên sản phẩm và bị phát hiện tức thời tại trạm kiểm tra tiếp theo. Tuy nhiên, khi hệ thống bị ngập lụt bởi hàng núi tồn kho bán thành phẩm, sự phản hồi này bị trì hoãn một cách tàn nhẫn. Một tín hiệu mất kiểm soát (Out-of-control Signal) có thể đã xảy ra ở trạm X, nhưng do lượng tồn kho đệm quá lớn, lô sản phẩm lỗi đó sẽ nằm ngủ yên trong kho nhiều tuần trước khi được chuyển đến trạm Y để phát hiện. Khoảng thời gian trễ (Time Lag) này phá vỡ hoàn toàn tính liên tục của dữ liệu theo thời gian thực, khiến cho việc vẽ biểu đồ X-bar R hay I-MR trở nên vô nghĩa vì chúng ta không thể xác định được sự cố thực sự đã xảy ra tại mốc thời gian nào để truy vết nguyên nhân gốc rễ. Để chứng minh tác động tiêu cực này với ban lãnh đạo doanh nghiệp, một Master Black Belt thường sử dụng mô hình Hồi quy tuyến tính đa biến (Multiple Linear Regression) nhằm lập bản đồ tương quan giữa khối lượng tồn kho bình quân (biến độc lập) và thời gian trung bình để phát hiện khuyết tật cùng với chi phí ẩn của vốn lưu động (các biến phụ thuộc). Mô hình hồi quy này thường cho thấy chỉ số R-bình phương (R-squared) rất cao, khẳng định rằng việc tích trữ tồn kho để đối phó với sự bất ổn của hệ thống thực chất là một quyết định kỹ thuật tự hủy diệt. Nó không những che giấu đi sự yếu kém thực sự của năng lực quy trình mà còn triệt tiêu động lực cải tiến, bởi vì những cảnh báo sớm từ hệ thống đo lường đã bị lớp đệm tồn kho hấp thụ hoàn toàn.

Chờ đợi (Waiting): Phân tích phân phối thống kê và Kẻ thù của Dòng chảy giá trị

Lãng phí chờ đợi thường bị hiểu lầm là một sự cố gián đoạn đơn giản do thiếu hụt nguyên vật liệu hoặc máy móc hư hỏng, nhưng trong tư duy phân tích hệ thống phức tạp, thời gian chờ chính là triệu chứng trực tiếp của sự mất cân bằng phương sai giữa các công đoạn liên tiếp. Khi chúng ta xây dựng Bản đồ Dòng chảy Giá trị (Value Stream Mapping - VSM) hiện tại, tham số Hiệu suất Chu kỳ Quy trình (Process Cycle Efficiency - PCE) thường tiết lộ những con số thảm hại, đôi khi chỉ đạt mức dưới năm phần trăm, ngụ ý rằng hơn chín mươi lăm phần trăm thời gian lưu trú của sản phẩm trong hệ thống là khoảng thời gian chết hoàn toàn không tạo ra bất kỳ giá trị gia tăng nào. Để giải mã lãng phí này một cách triệt để, chúng ta buộc phải rời khỏi vùng an toàn của lý thuyết Phân phối chuẩn (Normal Distribution) để bước vào lĩnh vực phân tích chuỗi Markov và lý thuyết xếp hàng nâng cao. Thời gian chờ đợi của máy móc hoặc con người hiếm khi phân bố đối xứng; chúng thường tuân theo Phân phối mũ (Exponential Distribution) hoặc Phân phối Weibull, đặc biệt là khi liên quan đến thời gian hỏng hóc và sửa chữa (MTBF và MTTR). Việc sử dụng sai giả định về phân phối chuẩn để tính toán thời gian dự trữ hoặc nhân lực thay thế sẽ dẫn đến những quyết định sai lầm nghiêm trọng trong thiết kế quy trình. Sự xuất hiện của lãng phí chờ đợi về mặt toán học chính là hậu quả của sự giao thoa giữa hai biến thiên độc lập: sự biến thiên trong tốc độ xuất hiện của công việc (Arrival Rate Variation) và sự biến thiên trong thời gian xử lý dịch vụ (Service Rate Variation). Khi độ lệch chuẩn của thời gian xử lý tại một trạm tăng lên do kỹ năng nhân viên không đồng đều hoặc do thiết bị thiếu ổn định, thời gian xếp hàng tại trạm đó sẽ tăng theo cấp số nhân chứ không phải cấp số cộng. Trong việc đánh giá các giải pháp giảm thiểu thời gian chờ, các chuyên gia sẽ tiến hành kiểm định giả thuyết thống kê (Hypothesis Testing) như kiểm định T-test hai mẫu (2-Sample T-test) hoặc kiểm định phi tham số Mann-Whitney để so sánh thời gian chờ trước và sau khi triển khai giải pháp cân bằng chuyền (Line Balancing). Một giá trị P-value có ý nghĩa thống kê sẽ cung cấp bằng chứng định lượng vững chắc rằng sự can thiệp kỹ thuật đã thực sự làm thay đổi cấu trúc thời gian của dòng chảy, từ đó nâng cao tốc độ chu chuyển của dòng tiền trong doanh nghiệp.

Thao tác (Motion): Tối ưu hóa không gian làm việc bằng Thiết kế thực nghiệm DOE

Lãng phí chuyển động, hay thao tác thừa của người lao động trong không gian làm việc, thường bị các nhà quản lý cấp trung bỏ qua vì họ cho rằng đó là những chi tiết vi mô không đáng kể. Thế nhưng, khi tích lũy hàng nghìn chu kỳ lặp lại trong một ca sản xuất, những chuyển động vô ích này không chỉ tiêu hao năng lượng sinh học của người lao động mà còn tạo ra những rủi ro tiêm nhiễm khuyết tật cực kỳ khó lường. Giao điểm giữa khoa học Công thái học (Ergonomics) và phương pháp luận Six Sigma nằm ở việc ứng dụng Thiết kế thực nghiệm (Design of Experiments - DOE) để thiết kế lại không gian thao tác một cách hoàn hảo nhất. Thay vì sử dụng phương pháp thử và sai (Trial and Error) thô sơ và tốn kém, một Master Black Belt sẽ thiết lập một mô hình thực nghiệm yếu tố phân đoạn (Fractional Factorial Design) để đánh giá đồng thời nhiều biến số liên quan đến bố cục trạm làm việc. Các yếu tố đầu vào (X) có thể bao gồm khoảng cách với tay tới khay linh kiện, chiều cao của bàn nâng thủy lực, góc nghiêng của màn hình hiển thị, và mức độ chiếu sáng công nghiệp. Biến phụ thuộc (Y) được lựa chọn để tối ưu hóa không chỉ là tổng thời gian hoàn thành thao tác (Cycle Time), mà còn là tỷ lệ sai sót vi mô hoặc nhịp tim phản ánh mức độ mệt mỏi của người thao tác. Thông qua việc phân tích biểu đồ Pareto của các hiệu ứng (Effects Pareto Chart) và biểu đồ tương tác (Interaction Plots) được sinh ra từ dữ liệu DOE, chúng ta có thể định lượng chính xác được biến số nào có tác động chính yếu (Main Effect) đến hiệu suất làm việc. Đáng ngạc nhiên là, các phân tích thống kê thường chỉ ra rằng sự tương tác giữa hai biến X có vẻ ít quan trọng (ví dụ: góc nghiêng khay chứa và cường độ ánh sáng) lại tạo ra một tác động hiệp đồng vô cùng lớn lên thời gian thao tác. Quyết định loại bỏ lãng phí chuyển động dựa trên phân tích DOE đảm bảo rằng chúng ta đang thiết kế các trạm làm việc dựa trên các bằng chứng toán học tối ưu thay vì trực giác, từ đó thiết lập một quy trình chuẩn xác, ít phương sai và bảo vệ sức khỏe dài hạn cho nguồn nhân lực cốt lõi.

Vận chuyển (Transportation): Tối ưu hóa mạng lưới và Phân tích Đa biến Multi-Vari

Trong cấu trúc chi phí vận hành, lãng phí vận chuyển thường được đo lường dưới dạng chi phí logistics hoặc khấu hao thiết bị nâng hạ. Tuy nhiên, sự phân tích thực sự có giá trị của một chuyên gia Six Sigma không chỉ nằm ở bài toán tối ưu hóa đường đi ngắn nhất (chẳng hạn như ứng dụng các thuật toán quy hoạch tuyến tính Linear Programming), mà còn ở việc định lượng xác suất hư hỏng và biến dạng sản phẩm sinh ra trong suốt quá trình trung chuyển. Vận chuyển hoàn toàn không gia tăng bất kỳ một giá trị cốt lõi nào cho sản phẩm theo định nghĩa của khách hàng, nhưng nó lại đóng vai trò như một chất xúc tác hoàn hảo cho các biến thiên ngoại lai xâm nhập vào hệ thống. Mỗi một lần sản phẩm được nhấc lên, di chuyển và đặt xuống là một cơ hội toán học (Opportunity for Defect) mở ra cho sự cố trầy xước, sốc nhiệt hoặc thất lạc. Để làm rõ mối liên hệ nhân quả này, công cụ Phân tích đa biến (Multi-Vari Analysis) được ứng dụng mạnh mẽ. Bằng cách thiết lập cấu trúc lấy mẫu lồng nhau (Nested Sampling), chúng ta có thể phân tách nguồn gốc của phương sai gây ra khuyết tật thành ba nhóm chính: biến thiên trong nội bộ một lô, biến thiên giữa các lô sản xuất, và biến thiên theo thời gian vận chuyển (Temporal Variation). Kết quả từ biểu đồ Multi-Vari thường tiết lộ những sự thật chấn động, chẳng hạn như phần lớn sự suy giảm chất lượng vật lý không xảy ra bên trong máy gia công, mà thực chất xảy ra trong quá trình di chuyển qua lại giữa các kho trung chuyển do sự rung lắc không được kiểm soát. Sự thấu hiểu này dẫn đến một quyết định chiến lược thay đổi hoàn toàn cục diện vận hành: thay vì đầu tư hàng triệu đô la vào việc mua máy móc mới có độ chính xác cao hơn, doanh nghiệp sẽ đạt được chỉ số ROI cao hơn nhiều bằng cách tái định tuyến lại dòng vật liệu, áp dụng sản xuất hình chữ U (U-shaped Cellular Manufacturing) để triệt tiêu hoàn toàn nhu cầu vận chuyển vật lý bằng xe nâng. Hành động kỹ thuật này trực tiếp loại bỏ hàm biến thiên sinh ra từ quá trình xử lý vật liệu, đồng thời tăng cường tốc độ phản ứng của chuỗi cung ứng.

Gia công thừa (Overprocessing): Hàm mất mát Taguchi và sự vi phạm các CTQ

Trong số tất cả các loại lãng phí, gia công thừa có lẽ là loại hình mang tính nghịch lý nhất và khó nhận diện nhất đối với những tổ chức tự hào về chất lượng cao. Nó bắt nguồn từ một sai lầm nhận thức kinh điển: niềm tin mù quáng rằng việc làm cho sản phẩm tốt hơn, mịn hơn, chính xác hơn mức mà khách hàng yêu cầu (và sẵn sàng chi trả) là một lợi thế cạnh tranh. Dưới góc độ khoa học kỹ thuật phân tích, lãng phí gia công thừa đại diện cho một sự vi phạm trắng trợn đối với nguyên tắc Đặc tính thiết yếu với Chất lượng (Critical-to-Quality - CTQ). Khi một kỹ sư quyết định đánh bóng một bề mặt kim loại đạt đến độ nhám Ra cực thấp trong khi bản vẽ kỹ thuật và nhu cầu thực tế của khách hàng chỉ yêu cầu mức độ trung bình, họ không tạo ra giá trị gia tăng mà đang lãng phí công suất máy móc, vật liệu mài mòn và thời gian lao động. Để phân tích sâu hiện tượng này, các chuyên gia phân tích thường viện dẫn đến Hàm mất mát Taguchi (Taguchi Loss Function), một khái niệm nền tảng trong thiết kế chất lượng mạnh mẽ (Robust Design). Khác với tư duy truyền thống cho rằng bất kỳ sản phẩm nào nằm trong giới hạn đặc tả (Specification Limits) đều tốt như nhau, hàm Taguchi chứng minh bằng một phương trình bậc hai L(y) = k(y - m)^2 rằng tổn thất kinh tế bắt đầu gia tăng ngay khi giá trị thực tế (y) lệch khỏi giá trị mục tiêu (m), bất kể nó tốt hơn hay kém hơn về mặt kỹ thuật. Việc nỗ lực gia công vượt quá yêu cầu kéo theo sự dịch chuyển giá trị trung bình của quy trình hoặc làm thu hẹp phương sai một cách tốn kém vô ích. Khi tiến hành đánh giá lại chỉ số năng lực quy trình thực tế so với giới hạn khách hàng, việc liên tục tạo ra chỉ số Cpk cao giả tạo ở những khía cạnh không được yêu cầu là minh chứng rõ ràng nhất của sự phân bổ nguồn lực sai lệch. Sự can thiệp kỹ thuật lúc này yêu cầu việc chuẩn hóa lại Dung sai (Tolerance Design) và tái cấu trúc các Hướng dẫn công việc tiêu chuẩn (Standard Operating Procedures), buộc toàn bộ hệ thống phải bám sát trục giá trị mục tiêu thay vì tự ý theo đuổi những tiêu chuẩn kỹ thuật không mang lại giá trị thương mại.

Khuyết tật (Defects): Kết quả đầu ra và Mô hình Hồi quy Logistic dự báo rủi ro

Khuyết tật không đơn thuần là một sản phẩm hỏng bị loại ra ở cuối băng chuyền; nó là hệ quả đau đớn nhất và là biểu hiện Y cuối cùng của một phương trình mà tất cả các lãng phí (X) bên trên đã tương tác và khuếch đại lẫn nhau. Phân tích khuyết tật ở cấp độ Master Black Belt không bao giờ được phép dừng lại ở việc biểu diễn tần suất lỗi bằng một biểu đồ cột đơn giản. Thay vào đó, chúng ta phải thiết lập một cơ chế dự báo sự xuất hiện của khuyết tật bằng các mô hình phân tích dữ liệu bậc cao, điển hình là Hồi quy Logistic (Logistic Regression). Bởi vì biến phụ thuộc trong trường hợp này mang tính chất nhị phân (Binary: Đạt hoặc Không Đạt), mô hình hồi quy tuyến tính thông thường sẽ vi phạm nghiêm trọng các giả định về sự phân tán đều của phần dư (Homoscedasticity). Hồi quy Logistic cho phép chúng ta tính toán trực tiếp xác suất xảy ra của một khuyết tật dựa trên một tập hợp các biến số vận hành đầu vào, ví dụ như tốc độ quay của động cơ, độ ẩm môi trường, độ dày vật liệu và thời gian lưu kho. Kết quả đầu ra của mô hình cung cấp các tỷ số chênh (Odds Ratios), chỉ ra chính xác mỗi khi một biến số X thay đổi một đơn vị, rủi ro sinh ra hàng lỗi sẽ tăng lên bao nhiêu lần. Bên cạnh đó, việc kết hợp chặt chẽ việc phân tích lãng phí khuyết tật với công cụ Phân tích Hình thức Sai lỗi và Tác động (Failure Mode and Effects Analysis - FMEA) tạo ra một hệ thống phòng ngừa vô cùng mạnh mẽ. Chỉ số RPN (Risk Priority Number) trong FMEA không còn là những con số dự đoán định tính chủ quan, mà được hiệu chuẩn lại hoàn toàn dựa trên các hệ số hồi quy được trích xuất từ mô hình thống kê dữ liệu lịch sử. Việc phân tích định lượng này giúp các nhà quản trị thấu hiểu sự thật rằng khuyết tật không bao giờ xảy ra ngẫu nhiên; chúng là những biến cố tất yếu có thể được dự báo trước và ngăn chặn từ trứng nước nếu chúng ta nắm vững phương trình truyền đạt phương sai của toàn bộ quy trình công nghệ.

Tương tác đa chiều giữa các biến số: Sự phức hợp của hệ sinh thái lãng phí

Một trong những sai lầm chết người nhất của các chương trình cải tiến liên tục truyền thống là xử lý 7 loại lãng phí một cách biệt lập và rời rạc, như thể chúng hoạt động trong các không gian chân không độc lập. Dưới lăng kính của tư duy hệ thống và phân tích thống kê đa biến, các lãng phí thực chất tương tác với nhau trong một mạng lưới phức tạp gồm các vòng lặp phản hồi dương và âm. Sản xuất thừa (Overproduction) trực tiếp bơm căng Tồn kho (Inventory). Lượng tồn kho phình to này lại bắt buộc doanh nghiệp phải gia tăng Vận chuyển (Transportation) để sắp xếp chỗ chứa, từ đó kéo theo việc tăng cường lãng phí Thao tác (Motion) khi công nhân phải tìm kiếm vật tư trong một không gian hỗn loạn. Trong quá trình đó, lượng hàng xếp chồng lên nhau quá lâu chờ đợi (Waiting) dẫn đến rỉ sét hoặc lỗi mốt, cuối cùng biến thành Khuyết tật (Defects). Mối tương quan liên kết này có thể được chứng minh toán học thông qua các Ma trận hiệp phương sai (Covariance Matrices) hoặc phân tích thành phần chính (Principal Component Analysis - PCA), trong đó các dạng lãng phí khác nhau thực chất biến thiên cùng chiều và chia sẻ chung các nguyên nhân gốc rễ (Latent Variables). Do đó, khi một kỹ sư nỗ lực tối ưu hóa cục bộ để giảm thời gian chờ đợi tại một trạm duy nhất mà không xem xét năng lực của toàn bộ chuỗi (như trong thuyết Ràng buộc - Theory of Constraints), họ thực chất chỉ đang dịch chuyển lãng phí từ trạng thái này sang trạng thái khác, đẩy lượng công việc dồn ứ sang trạm tiếp theo và phá vỡ sự cân bằng chung. Khả năng nhìn nhận sự tương tác đa chiều này chính là ranh giới phân định giữa một người thực hành Lean cơ bản và một chiến lược gia Master Black Belt. Mọi sự can thiệp kỹ thuật vào quy trình đều phải được mô phỏng trước thông qua các phần mềm giả lập sự kiện rời rạc (Discrete Event Simulation) để dự báo tác động dây chuyền, đảm bảo rằng một giải pháp tiêu diệt loại lãng phí X sẽ không vô tình làm bùng phát một loại lãng phí Y tồi tệ hơn ở hạ nguồn.

Kết luận: Tối ưu hóa hệ thống kinh doanh và quyền lực của phân tích định lượng

Tựu trung lại, sức mạnh của phân tích 7 loại lãng phí không nằm ở việc học thuộc lòng các thuật ngữ viết tắt TIMWOOD, mà nằm ở tư duy định lượng hóa mọi dạng suy hao trong hệ thống vận hành. Khi chúng ta ứng dụng tư duy của một Master Black Belt, quá trình cải tiến doanh nghiệp biến thành một phòng thí nghiệm thống kê khổng lồ. Mọi quyết định thay đổi phương thức làm việc đều phải dựa trên các giả thuyết được kiểm định nghiêm ngặt, với giá trị P-value nhỏ hơn mức rủi ro Alpha cho phép, và các kết quả tối ưu hóa phải được duy trì bền vững thông qua việc giới hạn phương sai trong biểu đồ kiểm soát SPC. Tồn kho không còn là tài sản mà trở thành độ trễ của thông tin; sản xuất thừa không còn là năng suất cao mà là sự nhiễu loạn luồng giá trị; gia công thừa biến thành sự vi phạm tốn kém đối với hàm mất mát chất lượng. Nhờ vào việc tích hợp sức mạnh của thiết kế thực nghiệm DOE, mô hình hồi quy đa biến và các nguyên tắc công thái học, chúng ta hoàn toàn có thể bóc tách cấu trúc gen của mọi quy trình sản xuất và dịch vụ. Cuộc chiến chống lại 7 loại lãng phí, do đó, là một cuộc chiến của dữ liệu, của sự am hiểu sâu sắc về phân phối xác suất và của khả năng kiểm soát sự biến thiên. Chỉ khi nào lãnh đạo doanh nghiệp sẵn sàng trang bị tư duy thống kê biện chứng này vào sâu trong văn hóa cốt lõi, khi đó toàn bộ tiềm năng sinh lời thực sự của tổ chức mới được giải phóng, biến những lãng phí vô hình thành những lợi thế cạnh tranh mang tính định lượng, bền vững và không thể sao chép trên thị trường toàn cầu.

Lean Helper@Gemba: Chuyển hóa triết lý Lean thành dữ liệu định lượng từ video hiện trường

Trong các chương trình cải tiến Lean Six Sigma, thách thức lớn nhất thường không nằm ở việc lựa chọn công cụ phân tích như ANOVA, DOE, Regression hay SPC, mà nằm ở khả năng thu thập dữ liệu vận hành thực tế tại Gemba. Rất nhiều hoạt động quan trọng như thao tác của người vận hành, thời gian chờ đợi, chuyển động thừa hoặc vận chuyển vật liệu thường không được ghi nhận đầy đủ trong các hệ thống quản lý như ERP hay MES. Điều này khiến việc xây dựng các mô hình phân tích Y = f(X) trở nên khó khăn vì thiếu dữ liệu định lượng từ hiện trường.

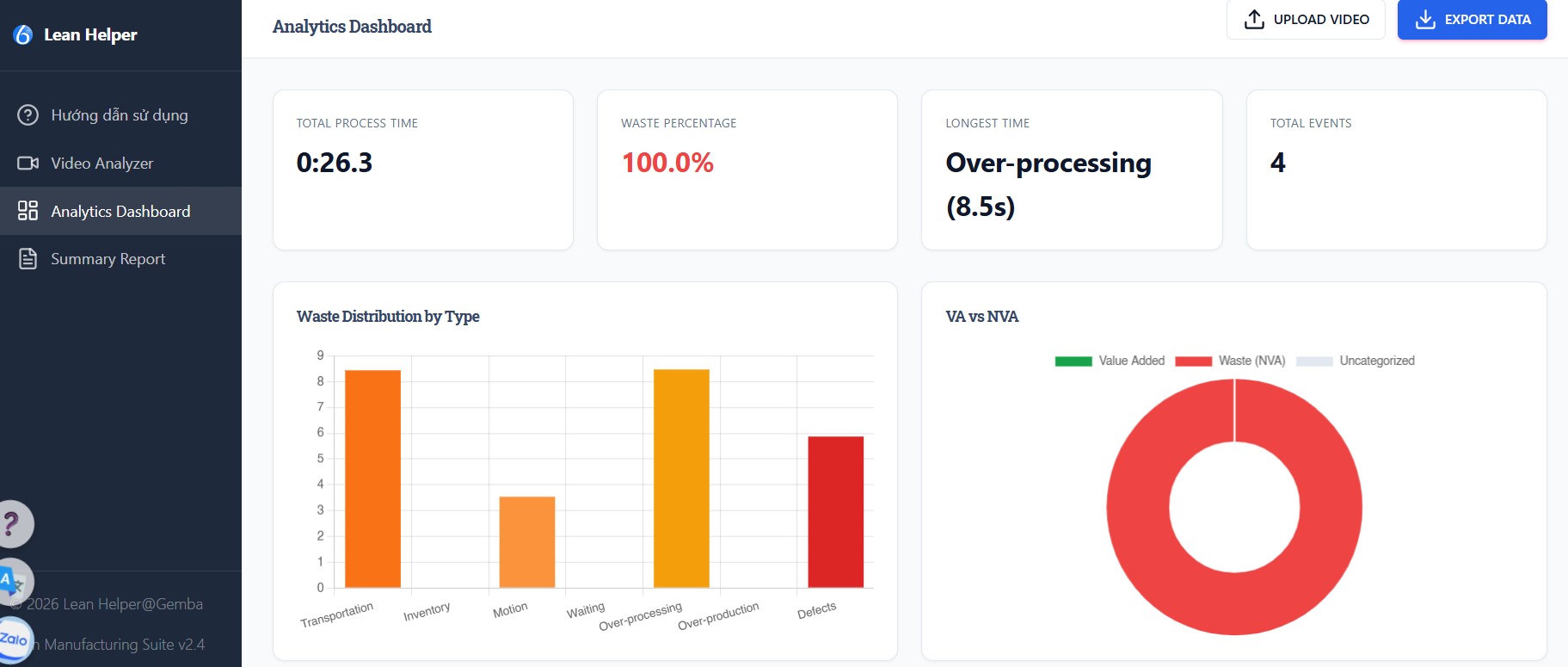

Để giải quyết khoảng trống này, Lean Helper phát triển nền tảng Lean Helper@Gemba – Ứng dụng Lean 7 Waste Video Analyzer, một công cụ phân tích video hiện trường giúp tự động nhận diện và định lượng 7 loại lãng phí (TIMWOOD) trong sản xuất và vận hành.

Khác với phương pháp Gemba Walk truyền thống phụ thuộc vào quan sát thủ công, Lean Helper@Gemba sử dụng phân tích video kết hợp với mô hình dữ liệu thao tác để chuyển các hoạt động vi mô trong quy trình thành dữ liệu định lượng có thể đo lường và phân tích thống kê.

Giá trị cốt lõi của Lean Helper@Gemba

1. Chuyển đổi video hiện trường thành dữ liệu cải tiến

Hệ thống phân tích video để trích xuất các chỉ số vận hành quan trọng như:

- Thời gian chu kỳ (Cycle Time)

- Thời gian chờ đợi (Waiting Time)

- Tần suất thao tác thừa (Motion Waste)

- Khoảng cách vận chuyển vật liệu (Transportation Waste)

- Tỷ lệ thời gian không tạo giá trị (Non Value Added Time)

Những dữ liệu này giúp các chuyên gia Lean Six Sigma xây dựng các mô hình phân tích quy trình chính xác hơn thay vì dựa trên ước lượng chủ quan.

2. Định lượng 7 loại lãng phí theo mô hình TIMWOOD

Lean Helper@Gemba hỗ trợ phân tích và phân loại các hoạt động theo mô hình 7 loại lãng phí:

- Overproduction – Sản xuất thừa

- Inventory – Tồn kho

- Waiting – Chờ đợi

- Motion – Thao tác thừa

- Transportation – Vận chuyển

- Overprocessing – Gia công thừa

- Defects – Khuyết tật

Kết quả phân tích được trình bày trực quan thông qua dashboard và báo cáo timeline video, cho phép xác định rõ loại lãng phí nào đang chiếm tỷ trọng lớn nhất trong chu kỳ sản xuất.

3. Nền tảng dữ liệu cho phân tích Lean Six Sigma nâng cao

Dữ liệu thu được từ video hiện trường có thể được sử dụng trực tiếp cho các phân tích nâng cao như:

- ANOVA để so sánh hiệu suất giữa các phương pháp thao tác

- Regression để xác định yếu tố ảnh hưởng đến Cycle Time

- Design of Experiments (DOE) để tối ưu bố trí trạm làm việc

- Statistical Process Control (SPC) để giám sát sự ổn định của quy trình

Nhờ đó, Lean Helper@Gemba đóng vai trò như cầu nối giữa Gemba và phân tích dữ liệu nâng cao trong các dự án cải tiến.

4. Tăng tốc các dự án Lean Six Sigma

Trong nhiều dự án cải tiến, giai đoạn thu thập dữ liệu trong bước Measure của chu trình DMAIC có thể chiếm tới 40–60% tổng thời gian dự án. Việc sử dụng phân tích video giúp:

- Rút ngắn thời gian thu thập dữ liệu

- Tăng độ chính xác của Time Study

- Giảm phụ thuộc vào quan sát thủ công

- Tăng tốc quá trình phân tích và cải tiến

Từ Gemba Walk đến Gemba Analytics

Nếu Gemba Walk giúp nhà quản lý “đi và nhìn thấy vấn đề”, thì Lean Helper@Gemba giúp tổ chức đo lường, phân tích và mô hình hóa vấn đề bằng dữ liệu.

Trong bối cảnh chuyển đổi số sản xuất và nhà máy thông minh, việc kết hợp video analytics với Lean Six Sigma mở ra một hướng tiếp cận mới: biến Gemba từ nơi quan sát thành nguồn dữ liệu định lượng cho tối ưu hóa hệ thống vận hành.

Xem demo giải pháp:

https://leanhelper.vn/ung-dung-phan-tich-7-loai-lang-phi-demo/

Giải đáp thắc mắc chuyên môn

Q: Tại sao sản xuất thừa lại được coi là lãng phí tồi tệ nhất dưới lăng kính phân tích thống kê?

Dưới góc độ thống kê và lý thuyết xếp hàng, sản xuất thừa can thiệp thô bạo vào định luật Little, làm tăng đột biến lượng WIP và làm phương sai của thời gian chu kỳ (Lead Time) mất kiểm soát. Nó tạo ra nhiễu hệ thống, làm gián đoạn luồng chảy giá trị và sinh ra 6 loại lãng phí còn lại thông qua các tương tác đa biến dây chuyền.

Q: Tồn kho ảnh hưởng như thế nào đến độ nhạy của Biểu đồ kiểm soát SPC?

Tồn kho đóng vai trò như một bộ lọc nhiễu tín hiệu tần số thấp. Nó tạo ra độ trễ thời gian (time lag) giữa thời điểm xảy ra lỗi và thời điểm phát hiện lỗi, làm cho các điểm dữ liệu trên biểu đồ kiểm soát X-bar R bị lệch pha. Điều này khiến việc truy vết các nguyên nhân đặc biệt (special causes) trở nên bất khả thi do sự ngắt quãng thông tin thời gian thực.

Q: Có thể dùng Thiết kế thực nghiệm (DOE) để giảm thiểu lãng phí thao tác như thế nào?

DOE đặc biệt là các thiết kế yếu tố phân đoạn (Fractional Factorial) cho phép đánh giá đồng thời nhiều biến X liên quan đến không gian làm việc như độ cao, ánh sáng, góc nghiêng và khoảng cách. Bằng cách phân tích biểu đồ Pareto và biểu đồ tương tác, người ta có thể tìm ra phương án kết hợp tối ưu nhằm cực tiểu hóa biến Y là thời gian thao tác và sai sót công thái học.

Q: Khái niệm Hàm mất mát Taguchi liên quan gì đến lãng phí gia công thừa?

Hàm mất mát Taguchi chứng minh rằng tổn thất kinh tế gia tăng theo hàm bậc hai ngay khi sản phẩm lệch khỏi giá trị mục tiêu (Target), dù vẫn nằm trong giới hạn cho phép. Lãng phí gia công thừa là việc tiêu tốn nguồn lực để tạo ra mức chất lượng dư thừa không cần thiết, làm dịch chuyển trung bình quy trình một cách tốn kém mà không mang lại giá trị thực tế cho khách hàng.

Q: Tìm kiếm giải pháp đào tạo chuyên sâu?

Để nâng cao năng lực phân tích dữ liệu và tư duy hệ thống, bạn có thể tham gia lộ trình: Khóa đào tạo Lean Six Sigma